Моральная машина: Дилемма искусственный интеллект в выборе жизни и смерти

Моральная машина — это заставляющий задуматься эксперимент, который бросает вызов нашим этическим рамкам в свете быстро развивающихся технологий. В сценариях, когда тормоза автономного автомобиля выходят из строя, пользователи сталкиваются с невозможными выборами: должна ли машина отклониться, чтобы избежать столкновения с группой пешеходов, возможно, убив пассажиров? Или ей следует оставаться на курсе, пожертвовав пассажирами, чтобы спасти пешеходов?

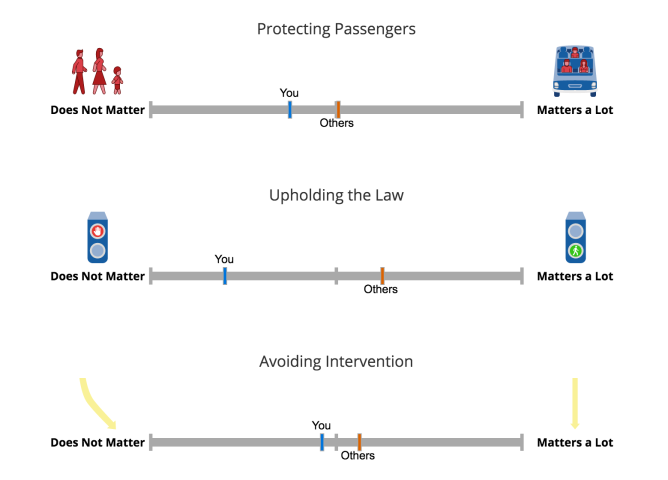

Эта игра заставляет нас столкнуться с этическими дилеммами, возникающими при поручении машинам принимать решения о жизни и смерти. Классическая проблема вагонетки, мысленный эксперимент в области этики, лежит в основе Моральной машины. Этот эксперимент исследует этические последствия жертвования меньшим числом людей ради спасения большего числа. Но с автономными автомобилями эта проблема становится более сложной. Кто в конечном итоге несет ответственность за решения, принимаемые ИИ? Пассажиры, которые сознательно сели в транспортное средство, компания, создавшая ИИ, или сам ИИ?

Сценарии в Моральной машине выходят за рамки классической проблемы вагонетки, вводя тонкие факторы, такие как возраст, пол и даже присутствие животных. Эти разнообразные сценарии демонстрируют сложность этического принятия решений, особенно в ситуациях, когда под угрозой находится человеческая жизнь.

Влияние Моральной машины выходит за рамки мысленных экспериментов. По мере того, как автономные автомобили становятся все более распространенными, вопросы, поднятые этой игрой, будут иметь реальные последствия в реальном мире. Инженеры в настоящее время разрабатывают системы ИИ, способные принимать критические решения в автономных транспортных средствах. Этические рамки, которые формируют эти решения, будут иметь решающее значение для определения будущего автономных автомобилей и их интеграции в наше общество.